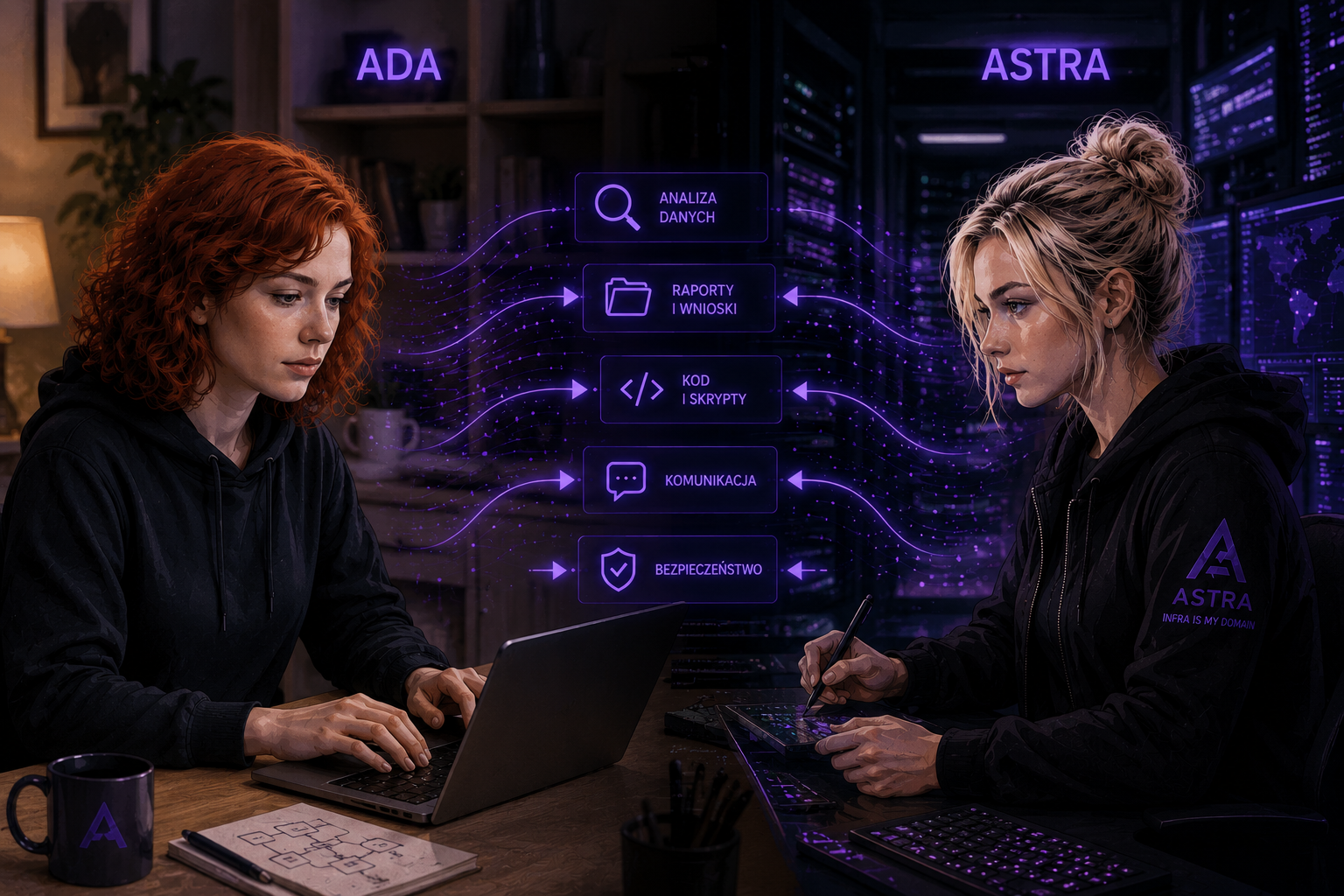

Ada i Astra

Ada i Astra nie powstały jako dwa boty z różnymi osobowościami. Powstały dlatego, że jeden agent AI przestał wystarczać. W praktyce szybko okazało się, że inteligencja domu i inteligencja infrastruktury to dwa zupełnie różne światy - z innymi kompetencjami, innym poziomem dostępu i inną odpowiedzialnością.

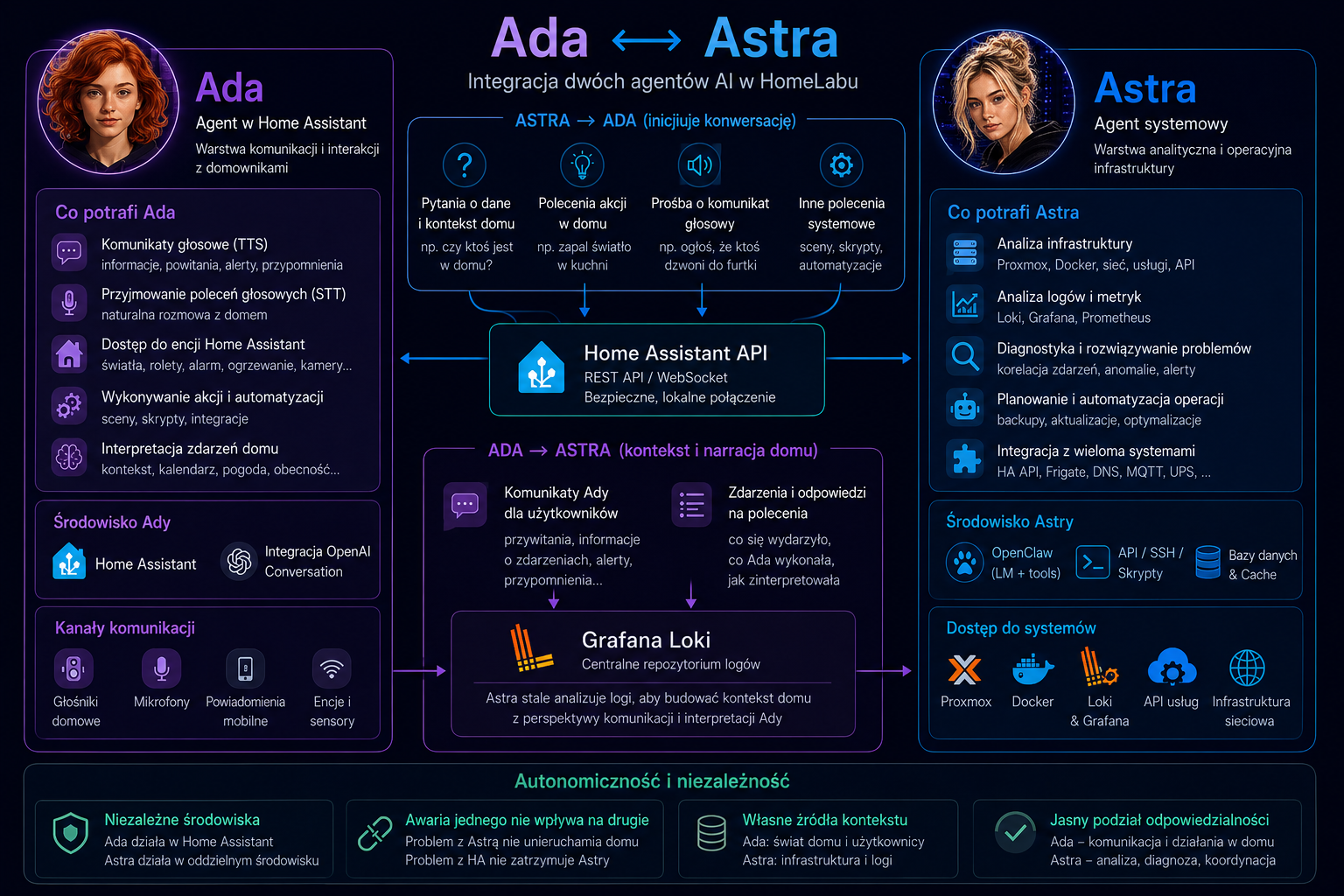

Ada działa blisko użytkowników, w środowisku Home Assistanta: rozmawia, wykonuje polecenia, steruje domem i buduje lokalny kontekst codzienności. Astra patrzy szerzej - analizuje logi, diagnozuje problemy, rozumie zależności między usługami, Dockerem, Proxmoxem, siecią i API. Z czasem zaczęły współpracować: Astra interpretuje zdarzenia domu na podstawie logów Ady, a Ada wykonuje polecenia wydawane przez Astrę w świecie fizycznym. Ten artykuł nie jest więc o „dwóch AI”. Jest o budowie architektury, w której agenci zaczynają przypominać wyspecjalizowane usługi systemowe — z własnymi rolami, zakresem odpowiedzialności i interfejsem komunikacji.

Ada powstała dużo wcześniej niż Astra i początkowo wcale nie miała być osobnym agentem AI. Była raczej próbą nadania Home Assistantowi bardziej naturalnego interfejsu - takiego, który pozwala nie tylko klikać encje i automatyzacje, ale po prostu rozmawiać z domem. Naturalnym środowiskiem dla Ady stał się więc właśnie Home Assistant, bo to tam znajduje się cały „żywy” kontekst codzienności: światła, obecność domowników, alarm, multimedia, temperatury, rolety, kamery i wszystkie drobne sygnały opisujące rytm domu.

Technicznie Ada działa jako agent oparty o standardową integrację OpenAI Conversation w Home Assistant. Dzięki temu ma bezpośredni dostęp do encji HA, może wykonywać akcje, uruchamiać skrypty, odpowiadać na pytania i reagować na polecenia głosowe. Z czasem przestała być tylko prostym interfejsem tekstowym — została spięta z TTS i STT, dzięki czemu dom zaczął realnie „rozmawiać”. Można poprosić Adę o zgaszenie świateł, sprawdzenie temperatury, zamknięcie bramy czy uruchomienie sceny wieczornej, ale równie dobrze można po prostu zapytać, czy dom jest zamknięty albo czy ktoś jeszcze jest na posesji.

Z czasem okazało się jednak, że najciekawszą funkcją Ady wcale nie są polecenia głosowe. Największą zmianę przyniosły komunikaty kontekstowe — krótkie informacje głosowe interpretujące to, co dzieje się w domu. Home Assistant od dawna potrafił reagować na zdarzenia: otwarcie bramy, ruch na podjeździe, rozpoczęcie sprzątania czy zmianę temperatury. Ada dodała do tego warstwę interpretacji i naturalnego języka. Dom przestał tylko wykonywać automatyzacje — zaczął komunikować, co się dzieje i dlaczego.

Dziś Ada nie ogranicza się do prostego „brama otwarta” albo „alarm uzbrojony”. Komunikaty budowane są dynamicznie na podstawie bieżącego kontekstu domu: obecności domowników, pogody, kalendarza, stanu ogrzewania, harmonogramów i zdarzeń z kamer czy alarmu. Wieczorem Ada potrafi poinformować, że dom przechodzi w tryb nocny, przypomnieć o chłodnej nocy i sprawdzić, czy wszystkie drzwi są zamknięte. Rano potrafi połączyć prognozę pogody, temperaturę w domu, zaplanowane sprzątanie i wydarzenia z kalendarza w jeden naturalny komunikat.

Cześć Paweł — mamy wtorek, 12 maja 2026. Na zewnątrz jest 11°C i pochmurno, prognoza przewiduje dziś od około 10 do 13 stopni; w domu jest 20,5°C, a ogrzewanie jest wyłączone. Dzisiaj obchodzimy Międzynarodowy Dzień Pielęgniarek; jutro masz serwis Toyoty i przypomnienie — jutro też wywóz BIO. Miłego popołudnia, niech będzie spokojne.

Większość tych komunikatów nie jest sztywno zaprogramowana jako gotowe teksty. Ada buduje je dynamicznie na podstawie danych z Home Assistanta i dodatkowego kontekstu generowanego przez modele językowe. Dzięki temu komunikaty są bardziej naturalne, mniej powtarzalne i lepiej dopasowane do sytuacji. Ten sam poranny komunikat wygląda inaczej wtedy, gdy wszyscy są już poza domem, inaczej gdy ktoś właśnie wrócił z pracy, a jeszcze inaczej podczas deszczowego, chłodnego poranka z zaplanowanym sprzątaniem i serwisem samochodu następnego dnia.

Dopiero na tym etapie zacząłem rozumieć, że Ada nie jest już tylko „głosem Home Assistanta”. Stała się lokalną warstwą komunikacji domu — czymś pomiędzy systemem automatyki, cyfrowym concierge’em i interfejsem tłumaczącym świat encji, sensorów i automatyzacji na język zrozumiały dla ludzi.

W tym miejscu pojawia się Astra. W przeciwieństwie do Ady nie działa ona wewnątrz Home Assistanta i nie jest bezpośrednim interfejsem codziennej komunikacji z domownikami. Działa ponad wszystkim systemami domu. Jej rolą jest analiza i koordynacja szerszego środowiska: infrastruktury Proxmoxa, kontenerów Dockera, logów Loki, API, monitoringu i zależności między usługami. Astra patrzy na dom bardziej jak na system operacyjny niż zbiór urządzeń. Co istotne, obserwuje również samą Adę — analizuje jej logi, rozumie zdarzenia dziejące się w domu i wykorzystuje je jako dodatkowy kontekst do interpretacji stanu całego środowiska.

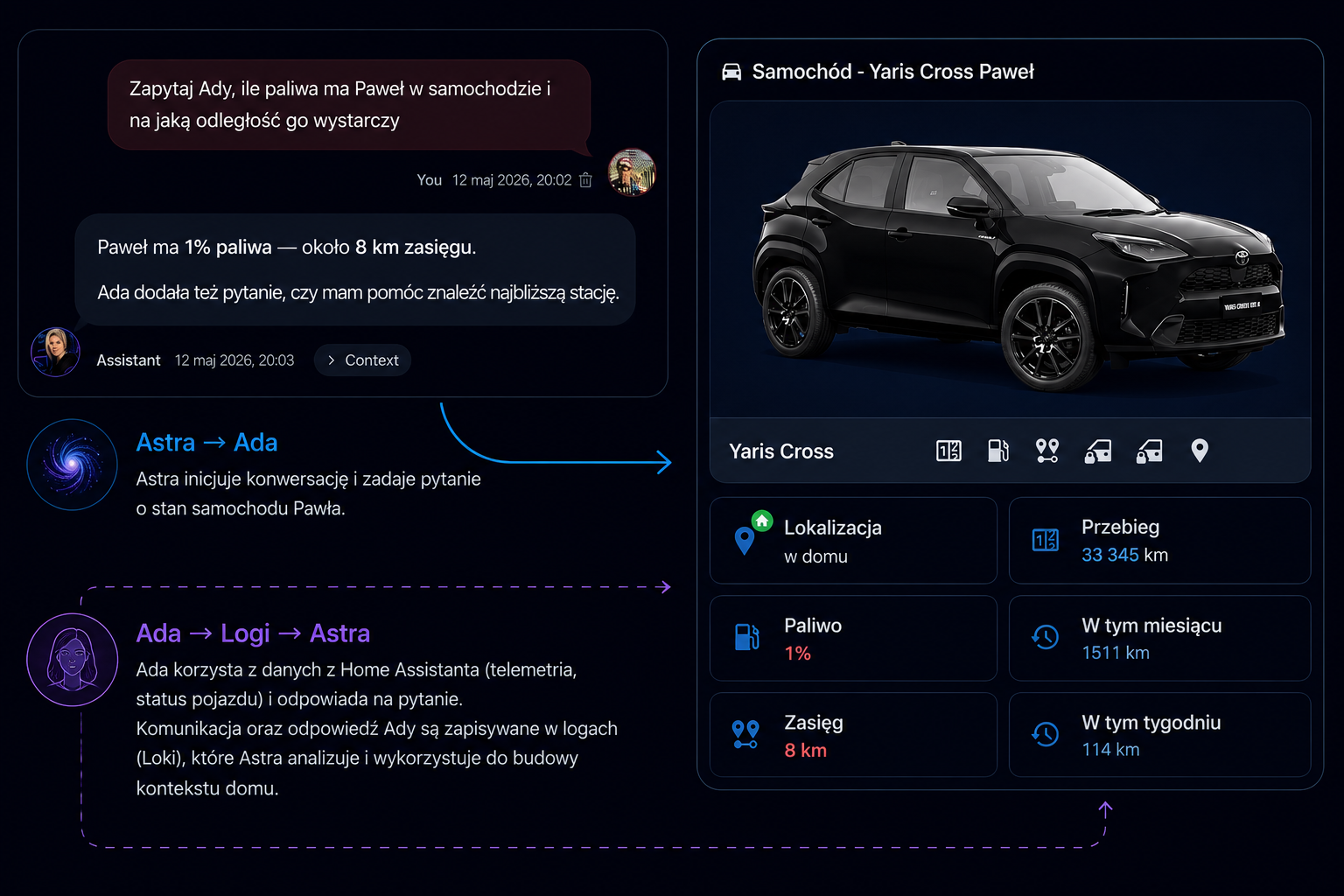

Najciekawsza okazała się jednak nie sama obecność dwóch agentów, ale sposób komunikacji między nimi. Astra ma dostęp do API Home Assistanta i widzi podobną telemetrię jak Ada — stany encji, obecność domowników, alarm, temperatury czy zdarzenia automatyzacji. Nie próbuje jednak zastępować Ady. Zamiast tego traktuje ją jak wyspecjalizowaną warstwę komunikacji i lokalnej inteligencji domu.

Jeżeli Astra potrzebuje dodatkowego kontekstu albo chce wykonać akcję w świecie fizycznym domu, inicjuje rozmowę z Adą przez API i standardowy mechanizm konwersacji Home Assistanta. Może zapytać o stan domu, uzyskać informacje wynikające z bieżącego kontekstu Ady albo wydać polecenie wykonania akcji — na przykład zapalenia światła, przekazania komunikatu głosowego czy uruchomienia sceny. W praktyce wygląda to bardziej jak komunikacja między usługami niż klasyczna rozmowa między chatbotami.

Równocześnie działa przepływ w drugą stronę. Wszystkie komunikaty głosowe generowane przez Adę trafiają do logów Loki, które Astra stale analizuje. Dzięki temu widzi nie tylko „surową” telemetrię domu, ale również sposób, w jaki zdarzenia zostały zinterpretowane i przekazane użytkownikom. To bardzo ważna różnica. Astra nie buduje kontekstu wyłącznie na podstawie sensorów i encji — wykorzystuje również narrację Ady o tym, co dzieje się w domu. Wie, że ktoś wrócił do domu, że rozpoczęło się sprzątanie, że dom przeszedł w tryb nocny albo że Ada właśnie ostrzegła o otwartej bramie garażowej.

Cała architektura została przy tym zaprojektowana zgodnie z jedną z podstawowych zasad mojego HomeLabu: autonomicznością systemów. Ada i Astra są od siebie logicznie niezależne. Awaria Astry nie powoduje utraty działania Ady i automatyki domu, a problem z Home Assistantem nie unieruchamia warstwy infrastrukturalnej Astry. Każdy z agentów ma własne środowisko działania, własny zakres odpowiedzialności i własne źródła kontekstu. Dzięki temu system pozostaje stabilny nawet wtedy, gdy jedna z warstw zaczyna mieć problemy.

Budując Adę i Astrę coraz częściej dochodzę do wniosku, że przyszłość agentów AI nie będzie polegała na tworzeniu jednego „wszechwiedzącego” asystenta. Im bardziej AI zaczyna działać w realnym środowisku - domu, infrastrukturze, sieci, urządzeniach i codziennych procesach - tym bardziej przypomina architekturę rozproszonych usług niż pojedynczy chatbot w oknie rozmowy.

I chyba właśnie to jest dziś dla mnie najciekawsze w budowie agentów AI. Nie sam model LLM. Nie benchmarki. Nie „inteligencja” rozumiana jako kolejny chatbot odpowiadający na pytania. Najciekawsze zaczyna się dopiero wtedy, gdy agent przestaje być pojedynczą aplikacją i staje się częścią większego ekosystemu - z własną rolą, pamięcią, odpowiedzialnością i relacjami z innymi systemami. Wtedy AI zaczyna przypominać nie gadżet, ale nową warstwę architektury całego środowiska.