Co dla Agenta AI jest ważniejsze od samego modelu LLM?

Mam wrażenie, że w dyskusjach o AI bardzo mocno skupiamy się dziś na samych modelach LLM. Który model jest lepszy, szybszy, bardziej „inteligentny”, tańszy albo ma większe okno kontekstu. A tymczasem przy budowie agentów AI coraz częściej dochodzę do wniosku, że sam model jest tylko częścią układanki - i często wcale nie najważniejszą.

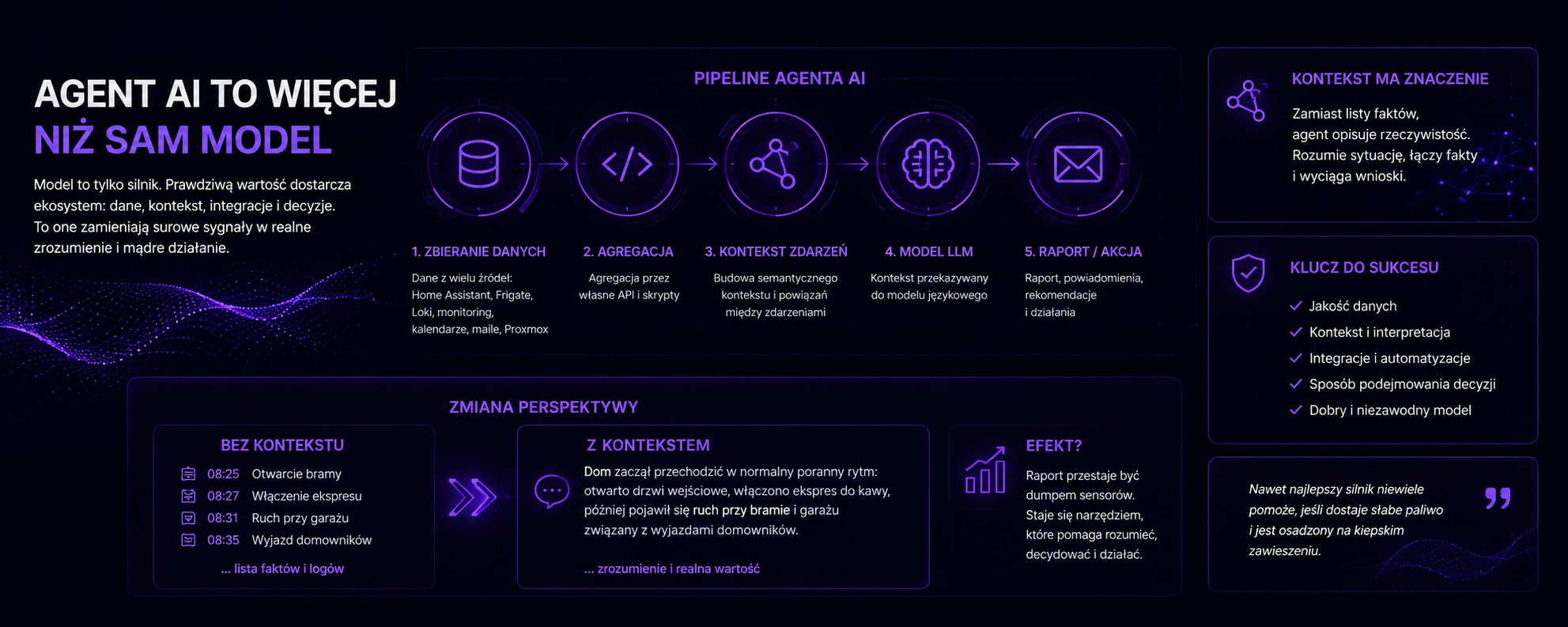

Model LLM dla agenta AI jest jak silnik dla samochodu. Jest bardzo ważny - ale sam nie wystarczy, żeby jazda dawała poczucie jakości i komfortu. O końcowym efekcie decyduje cały ekosystem wokół niego - wykończenie kabiny, elektronika, zawieszenie, linia nadwozia. Dla Agenta AI są to: dane, przepływ informacji, kontekst, integracje i sposób podejmowania decyzji.

W ostatnich dniach rozwijaliśmy z Astrą (moim homelabowym prywatnym agentem) cykliczne raporty stanu domu i infrastruktury. Początkowo raporty były poprawne technicznie, ale „drętwe” - przypominały bardziej dump sensorów i logów niż coś, co rzeczywiście pomaga zrozumieć sytuację. Co ciekawe Astra w oknie czatu dawała bardzo sensowne odpowiedzi - widać było, że dysponuje odpowiednimi danymi i umie je wykorzystać, jednak nie potrafi tego samego zrobić na poziomie renderowania raportu wysyłanego mailem.

Naturalnym odruchem było dalsze poprawianie promptów. Okazało się jednak, że prawdziwy przełom przyniosło coś innego: przebudowa pipeline’u danych i sposobu przygotowania kontekstu dla modelu.

Dziś Astra:

- zbiera dane z wielu źródeł (Home Assistant, Frigate, Loki, monitoring, kalendarze, maile, Proxmox),

- agreguje je przez własne API i skrypty,

- buduje semantyczny kontekst zdarzeń,

- a dopiero później przekazuje go do modelu LLM.

Efekt? Raport przestał być „listą faktów”, a zaczął opisywać rzeczywistość domu i infrastruktury.

Zamiast: „08:25 — otwarcie bramy”

Astra potrafi dziś napisać: „Dom zaczął przechodzić w normalny poranny rytm: otwarto drzwi wejściowe, włączono ekspres do kawy, później pojawił się ruch przy bramie i garażu związany z wyjazdami domowników.”

I właśnie tu pojawił się dla mnie najciekawszy wniosek: największą wartością agentów AI nie jest samo generowanie tekstu, ale zdolność interpretowania kontekstu i budowania znaczenia z wielu drobnych sygnałów. Coraz bardziej mam też wrażenie, że przyszłość agentów AI będzie zależała mniej od „magii modelu”, a bardziej od jakości pipeline’u przygotowującego dane i kontekst pod konkretne zadanie. W tym kontekście projektowanie architektury całego ekosystemu, w którym działa agent AI stanie się kluczową kompetencją we wdrażaniu tego rodzaju rozwiązań.

Model to tylko silnik. Powinien być dobry i niezawodny. Ale nawet najlepszy silnik niewiele pomoże, jeśli dostaje słabe paliwo i jest osadzony na kiepskim zawieszeniu.